Fundacja Panoptykon razem z Piotrem Sapieżyńskim, badaczem z University of Norhtwestern, przeprowadziła badanie, które ukazuje, w jaki sposób algorytmy reklamowe na platformach społecznościowych napędzają lęki użytkowników. Wbrew temu, co mówią same platformy – nie ma możliwości efektywnego wyeliminowania niepożądanych treści.

Gdy dzieci pójdą do szkoły, pandemia się rozkręci – scroll – SPONSOROWANE Najlepsze kursy programowania w mieście! – scroll – Z OSTATNIEJ CHWILI: Stan wyjątkowy na granicy – scroll – SPONSOROWANE Śmiertelna choroba niszczy życie Stasia! Liczy się każdy dzień! – scroll – Aśce urodziło się dziecko – scroll – SPONSOROWANE Psssst… Sprawdź nową ofertę na badanie przesiewowe SMA! – scroll – QUIZ Którym muppetem jesteś? – scroll – PROPONOWANE DLA CIEBIE Pomóż Magdzie w walce z glejakiem

„Przebadaj się, bo nowotwór nie wybiera!” Facebook wie, czego się boimy, i nie zawaha się tego użyć, żeby dobrać treści, które wyświetli ci w newsfeedzie. W przypadku bohaterki, której sprawę Fundacja Panoptykon wzięła pod lupę w ramach swojego eksperymentu, nie pomylił się: ta wyselekcjonowana przeplatanka reklam zbiórek na leczenie dzieci i propozycji badań w kierunku chorób, które te dzieci dotknęły, idealnie trafia w jej lęk o zdrowie swoje i najbliższych. I codziennie wzmacnia traumę związaną z utratą najbliższej osoby, która zmarła na nowotwór.

O tym, jak działanie algorytmów platform porządkujących treści w tzw. newsfeedzie (zarówno organicznych, jak i sponsorowanych) wpływa na zdrowie psychiczne użytkowników i użytkowniczek, wciąż niewiele się mówi. A warto, bo często nie mamy świadomości, że dzięki ogromnej ilości danych, które platformy gromadzą na nasz temat, mogą one nie tylko podsuwać nam produkty dopasowane do rzeczywistych potrzeb, ale też żerować na naszych słabościach czy pogłębiać lęki. Eksperyment opisał Financial Times.

Facebook żeruje na słabościach

Kiedyś „łączył ludzi”, dziś „pomaga kontaktować się z innymi osobami oraz udostępniać różne informacje i materiały”. Dla wielu osób Facebook to obecnie podstawowe źródło wiedzy o świecie. Dla bohaterki tej historii to źródło nie tylko informacji, ale też codziennego niepokoju.

„Nasza bohaterka to młoda matka, dla której – zwłaszcza od czasu, gdy jedno z rodziców zmarło na raka – zdrowie to drażliwy temat” – mówi Karolina Iwańska, prawniczka z Panoptykonu, która monitorowała eksperyment. „Gdy zaszła w ciążę, jej obawy rozszerzyły się na choroby, które dotykają głównie dzieci. W pewnym momencie zaobserwowała, że w jej newsfeedzie na Facebooku dominują reklamy dotyczące zdrowia. Wyświetlały się w określonej kolejności: najpierw te wywołujące najsilniejsze emocje (jak zbiórka na leczenie nienarodzonej jeszcze Ady, której »serduszko nie może przestać bić«, czy Leosia, który walczy z białaczką), a następnie… np. zniżka na badania genetyczne w kierunku nowotworu albo innej ciężkiej choroby” – opowiada.

Zainteresowana tą sprawą Fundacja Panoptykon poprosiła o pomoc badacza z Northeastern University – Piotra Sapieżyńskiego. Z pomocą Fundacji prześledził on ponad 2000 reklam, które pojawiły się w newsfeedzie naszej bohaterki w ciągu dwóch miesięcy. Eksperyment potwierdził, że średnio jedna na pięć reklam dotyczyła zdrowia (wśród nich znaczna część to reklamy zbiórek pieniędzy na chore dzieci). Do tego na liście tzw. zainteresowań badanej, które do celów reklamowych przypisał jej Facebook, znalazło się aż 21 kategorii związanych ze zdrowiem, w tym: onkologia, świadomość raka, wady genetyczne, nowotwór i rdzeniowy zanik mięśni (SMA).

„Nasza bohaterka była zbita z tropu. Nawet jeśli szukała w sieci informacji o rzadkiej chorobie, jaką jest SMA, nigdy nie określiłaby jej mianem swojego zainteresowania” – mówi Iwańska. „Facebook nadał temu słowu nowe znaczenie: zainteresowanie to coś, co cię »rusza« – jeśli więc wyświetli ci reklamę dotyczącą tego tematu, szansa na konwersję – czyli na to, że wykonasz oczekiwanie działanie – będzie większa. Portal nie kryje też, że informacje o tzw. zainteresowaniach swoich użytkowników i użytkowniczek czerpie nie tylko z własnych usług, ale także poza nimi” – dodaje. Wszędzie tam, gdzie sięgają macki jego piksela, czyli narzędzia używanego przez reklamodawców do mierzenia mitycznej konwersji (piksel pozwala śledzić, jak użytkownicy poruszają się między Facebookiem a stroną WWW danej marki).

Skażona arena kontaktów międzyludzkich

„Nie ma obowiązku korzystać z Facebooka” – pomyśli ktoś. To jednak nie takie proste: kontakty międzyludzkie, zwłaszcza w dobie pandemii, prawie całkowicie przeniosły się do świata online. Facebook stał się forum wymiany informacji, ale też umożliwia uczestnictwo np. w grupach czy wydarzeniach. Wiele firm wręcz wymaga od swoich pracowników aktywnego korzystania z tego portalu.

„W takim razie można wyczyścić zainteresowania w ustawieniach reklamowych, które oferuje platforma” – dopowie ktoś inny. Niestety, eksperyment Sapieżyńskiego i Panoptykonu pokazał, że działanie to nie daje użytkownikom realnej kontroli nad tym, jakie otrzymują treści.

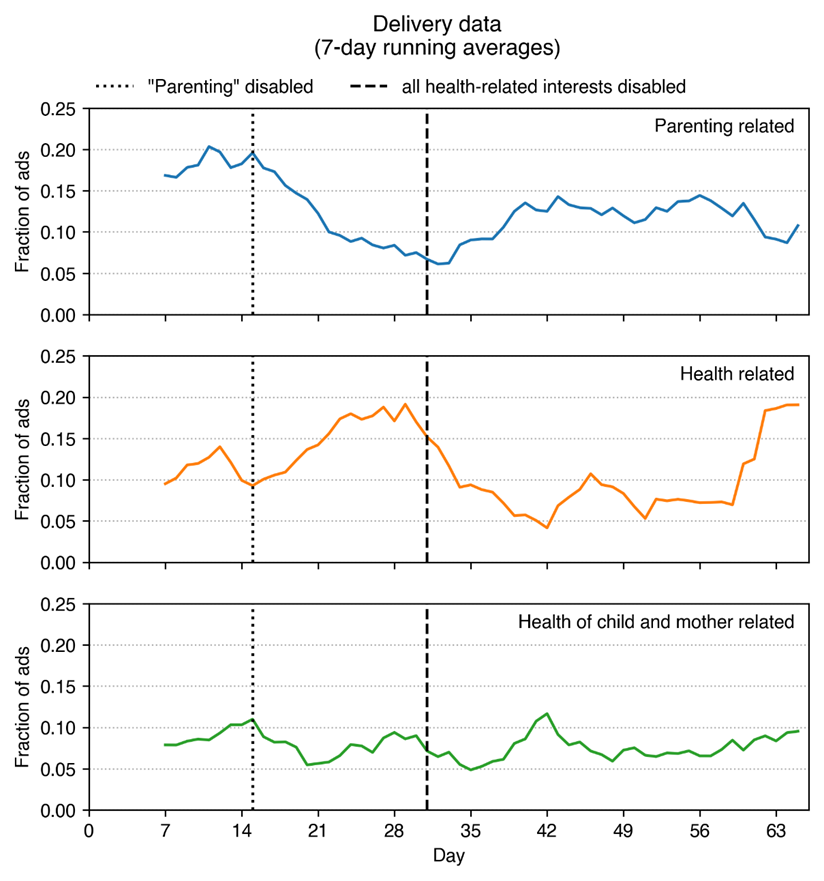

„Użytkowniczka kliknęła na Facebooku opcję, że chce oglądać »mniej reklam o rodzicielstwie«. Początkowo liczba reklam na ten temat spadła, ale za chwilę znów się odbiła, a na jej liście zainteresowań pojawiły się nowe kategorie, wśród których znalazło się także »rodzicielstwo« i »opieka nad dziećmi«” – mówi Sapieżyński. „Usunięcie z listy »zainteresowań« związanych ze zdrowiem doprowadziło co prawda do wyeliminowania reklam targetowanych przez reklamodawców według tych kategorii, ale Facebook dość szybko przypisał użytkowniczce nowe, podobne »zainteresowania«, takie jak »oddział intensywnej opieki medycznej«, »badania profilaktyczne« czy »rezonans magnetyczny«. Generalnie w dłuższej perspektywie żadna z tych zmian nie wpłynęła na istotne zmniejszenie wyjściowej liczby reklam zdrowotnych, w szczególności tych odbieranych jako najbardziej inwazyjne, tj. dotyczących zdrowia kobiet w ciąży i dzieci”. Na koniec eksperymentu użytkowniczka widziała mniej więcej tyle samo reklam związanych ze zdrowiem, co na początku.

„Stała ekspozycja na tak sugestywne treści nie może pozostać bez wpływu. W końcu na tym polega biznes Facebooka: wyświetla nam takie materiały, które z największym prawdopodobieństwem klikniemy, bo od tego zależy, ile miliardów dolarów portal zarobi w danym kwartale” – tłumaczy Iwańska. Ale nie ma róży (fortuny) bez kolców – w tym wypadku jest nią codzienna trauma osoby oglądającej tak dobrane treści. Ale to nie jedyna szkoda, do której może prowadzić taka personalizacja: inne badania dowiodły, że może ona sprzyjać także m.in. dyskryminacji na rynku pracy, podbijaniu zasięgów szkodliwych treści czy pogłębianiu polaryzacji społecznej.

Czy Unia Europejska rozwiąże problem?

Facebook działa jak agencja reklamowa, kreatywna, instytut badań konsumenckich i dom mediowy w jednym. Reklamodawca, który chce dotrzeć do klientów za pośrednictwem tej platformy, ma do dyspozycji różne kategorie, dzięki którym może zawęzić wyświetlanie reklam do konkretnej grupy docelowej, określonej np. względem płci, wieku, miejsca zamieszkania, aktywności na stronie czy zainteresowań.

Zawężanie grup docelowych reklam (np. do kobiet w określonym przedziale wiekowym czy osób, które samodzielnie określiły na portalu swoje zainteresowania) to wierzchołek góry lodowej. „Większym problemem jest personalizacja treści z wykorzystaniem zainteresowań określonych samodzielnie przez Facebooka na podstawie aktywności na portalach należących do kalifornijskiego giganta, a także poza nimi. Nasz eksperyment wskazuje na to, że nawet jeśli użytkownik lub użytkowniczka zmienią ustawienia tak, aby nie otrzymywać reklam od reklamodawców targetujących użytkowników o konkretnych »zainteresowaniach«, algorytmy Facebooka i tak dostarczą im podobne treści, »wiedząc«, że to właśnie one mają największą szansę wzbudzić »zaangażowanie«, które karmi systemy reklamowe cyfrowych gigantów” – wyjaśnia Iwańska.

Problem ten można rozwiązać poprzez wprowadzenie regulacji prawnych, które m.in. co do zasady zakazywałyby wykorzystywania danych osobowych do personalizacji treści, a także zwiększałyby przejrzystość algorytmów i nadzór nad ich funkcjonowaniem. Szansą na taką zmianę jest akt o usługach cyfrowych (Digital Services Act), nad którym obecnie pracują instytucje UE. „Niestety wstępny projekt tego dokumentu nie zawiera wystarczających odpowiedzi. Dlatego w ubiegłym tygodniu – wraz z 49 organizacjami z Europy – wystąpiliśmy do unijnych decydentów z listem otwartym, w którym przedstawiliśmy konkretne propozycje rozwiązań prawnych” – mówi Iwańska.

„Jak pokazał nasz eksperyment, nie wystarczy wprowadzić ograniczeń dla reklamodawców dotyczących targetowania. Jeśli chcemy uporać się z problemem manipulacji w sieci, kluczowa jest regulacja algorytmów” – wyjaśnia.

Reklamy przedstawione we wstępie są autentyczne. Imiona zostały zmienione.

Źródło: Fundacja Panoptykon

Treść dostępna na licencji CC BY-SA 4.0.

Artykuł może zawierać linki partnerów, umożliwiające rozwój serwisu i dostarczanie darmowych treści.

|

|

|

|

|

|

|

|

Stopka

- O nas | Redakcja

- Wywiady | Porady

- Prywatność & cookies

- Mapa serwisu | RSS

© 1998-2026 Dziennik Internautów Sp. z o.o.